Изменения происходят гораздо быстрее, чем ожидалось

Джеффри Хинтон, которого считают «крестным отцом искусственного интеллекта», говорит, что вероятность того, что ИИ приведет к вымиранию человечества в течение трех десятилетий, составляет от 10% до 20%, поскольку изменения происходят очень быстро.

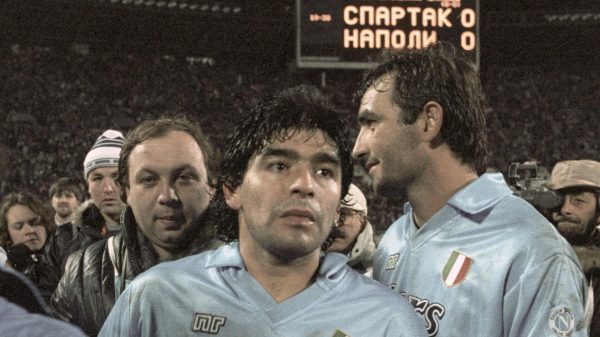

Фото: Аннет Ридл/dpa/Global Look Press

Фото: Аннет Ридл/dpa/Global Look Press

Британо-канадский ученый-компьютерщик, которого часто называют «крестным отцом» искусственного интеллекта, снизил вероятность того, что ИИ уничтожит человечество в течение следующих трех десятилетий, предупредив, что темпы изменений в технологиях «гораздо быстрее», чем ожидалось, The Guardian отчеты. <стр>Профессор Джеффри Хинтон, удостоенный в этом году Нобелевской премии по физике за свою работу в области искусственного интеллекта, заявил, что существует вероятность «от 10% до 20%», что искусственный интеллект станет причиной вымирания человечества в течение следующих трех десятилетий.

Ранее Хинтон заявлял, что существует вероятность 10% катастрофических последствий этой технологии для человечества.

Когда его спросили в программе Today на BBC Radio 4, изменил ли он свой анализ потенциального апокалипсиса ИИ и вероятности его возникновения, он сказал: «На самом деле нет, от 10% до 20%».

Оценка Хинтона побудила приглашенного редактора Today, бывшего канцлера Саджида Джавида, сказать: «Вы на верном пути», на что Хинтон ответил: «Ну, так оно и есть. Видите ли, нам никогда раньше не приходилось иметь дело с существами, более разумными, чем мы сами».

Ученый добавил: «А сколько примеров вы знаете, когда более разумное существо контролируется менее разумным существом?? Примеров очень мало. Есть мать и ребенок. Эволюция пошла на многое, чтобы позволить ребенку контролировать свою мать, но это, пожалуй, единственный пример, который я знаю».

Хинтон, родившийся в Лондоне, почетный профессор Торонтского университета, сказал, что люди были бы как малыши по сравнению с интеллектом мощных систем искусственного интеллекта.

«Мне нравится думать об этом так: представьте себя и трехлетнего ребенка. Нам будет три года», — сказал он.

Искусственный интеллект можно в широком смысле определить как компьютерные системы, которые выполняют задачи, которые обычно требуют человеческого интеллекта, The Guardian объясняет. <стр>В прошлом году Хинтон попал в заголовки газет после того, как уволился из Google, чтобы более открыто говорить о рисках неконтролируемого искусственного интеллекта, ссылаясь на опасения, что «плохие парни» будут использовать технологию, чтобы навредить другим. Ключевой проблемой для сторонников безопасности ИИ является то, что создание общего искусственного интеллекта или систем, которые умнее людей, может привести к тому, что технология станет экзистенциальной угрозой, поскольку она выйдет из-под контроля человека.

Размышляя о том, где, по его мнению, оказался ИИ, когда он впервые начал работать над технологией, Хинтон сказал: «Я не думал, что он будет там, где мы сейчас. Я думал, что в какой-то момент в будущем мы дойдем до этой точки».

«Крестный отец ИИ» добавил: «Потому что ситуация, в которой мы сейчас находимся, заключается в том, что большинство экспертов в этой области верят, что когда-нибудь, возможно, в течение следующих 20 лет, мы создадим ИИ, который будет умнее людей. И это очень пугающая мысль».

Хинтон сказал, что темпы разработки были «очень, очень быстрыми, намного быстрее, чем я ожидал», и призвал к государственному регулированию технологии.

«Меня беспокоит то, что невидимая рука не будет нас защищать. Так что если крупные компании хотят получать прибыль, этого будет недостаточно, чтобы обеспечить безопасность их разработок», — сказал он. «Единственное, что заставит эти крупные компании проводить больше исследований в области безопасности, — это государственное регулирование».

Хинтон — один из трех «крестных отцов искусственного интеллекта», которые получили премию ACM AM Turing — эквивалент Нобелевской премии по информатике — за свою работу. Однако один из троицы, Янн Лекун, преуменьшил экзистенциальную угрозу и сказал, что ИИ «на самом деле может спасти человечество от вымирания».

Свежие комментарии