Ребенок попросил умный динамик Echo сделать вызов, побудив ее мать опубликовать ответ в Twitter

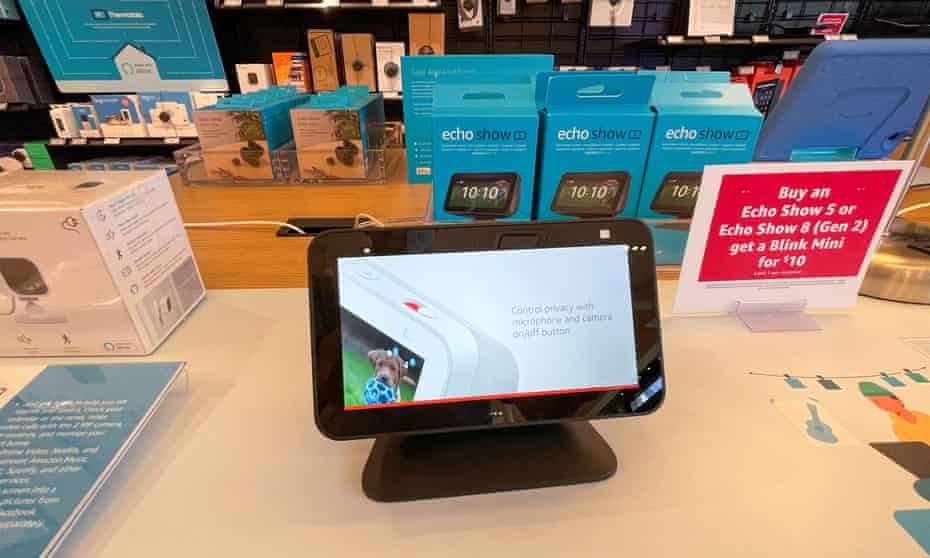

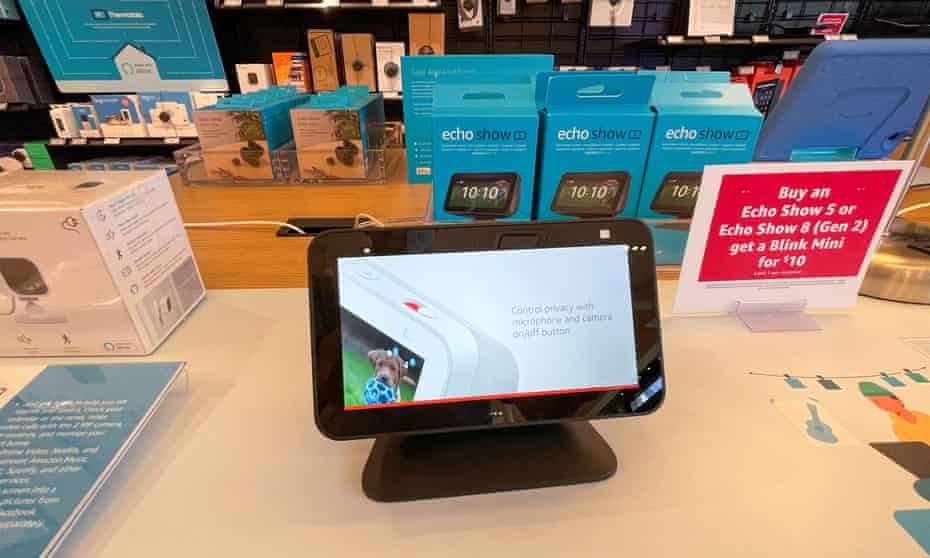

Мать написала в Твиттере свое возмущение после того, как ее умный динамик Echo посоветовал ее маленькой дочери прикоснуться монеткой к розетке под напряжением. Фотография: Майк Блейк/Reuters Мать написала в Твиттере свое возмущение после того, как ее умный динамик Echo посоветовал ее маленькой дочери прикоснуться к розетке под напряжением. Фотография: Майк Блейк/ReutersMaya Yang, чт, 30 декабря 2021 г., 00.09 по Гринвичу

Мать написала в Твиттере свое возмущение после того, как ее умный динамик Echo посоветовал ее маленькой дочери прикоснуться монеткой к розетке под напряжением. Фотография: Майк Блейк/Reuters Мать написала в Твиттере свое возмущение после того, как ее умный динамик Echo посоветовал ее маленькой дочери прикоснуться к розетке под напряжением. Фотография: Майк Блейк/ReutersMaya Yang, чт, 30 декабря 2021 г., 00.09 по Гринвичу

Последнее изменение: четверг, 30 декабря 2021 г., 00.11 по Гринвичу

Виртуальные помощники могут устанавливать таймеры для людей, воспроизводить музыку, управлять устройствами умного дома, отвечать на голосовые команды и устанавливать напоминания. По состоянию на воскресенье они также доказали свою способность бросать вызов детям на смертельную опасность.

Алекса, виртуальный помощник Amazon, недавно посоветовала 10-летней девочке прикоснуться к розетке с активной розеткой после того, как она попросила умный динамик Echo сделать вызов.

«Моя 10-летняя девочка только что спросила Алексу на нашем Echo о вызове, и это то, что она сказала», — сказала пользователь Кристин Ливдал в своем твите в воскресенье. К подписи она приложила снимок экрана с ответом Алексы.

«Вот кое-что, что я нашел в Интернете. Согласно сайту ourcommunitynow.com: задача проста: подключите зарядное устройство для телефона примерно на полпути к розетке, затем дотроньтесь пенни до открытых контактов », — говорится в ответе Алексы.

OMFG Моя 10-летняя девочка только что спросила Алексу на нашем Эхо о вызове, и вот что она сказала. pic.twitter.com/HgGgrLbdS8

& mdash; Кристин Ливдал (@klivdahl) 26 декабря 2021 г.

Вызов начал распространяться на TikTok около года назад и часто приводит к поражению электрическим током, а также к потенциальным пожарам и серьезным травмам на протяжении всей жизни.

Пользователи быстро выразили свое потрясение и тревогу по поводу твита, который с тех пор набрал 17 000 лайков и более 3 000 ретвитов.

Один пользователь написал в Твиттере: «Ой, это ужасно».

Другие высмеивали инцидент, при этом один из них сказал: «Очевидно, алгоритм AMZN понимает, что, предлагая эту задачу, клиенты позже должны будут покупать много всего, что нужно заменить после того, как дом сгорел ».

Другой пользователь сказал:« Чего вы ожидали, когда передали родительские обязанности ИИ ».

Amazon заявила, что с тех пор они решили проблему, а представитель сказал CNN: «Доверие клиентов находится в центре всего, что мы делаем, и Alexa предназначена для предоставления точной, актуальной и полезной информации для клиентов ».

« Как только мы узнали об этой ошибке, мы быстро исправили ее и продолжим совершенствовать наши системы, чтобы предотвратить подобные ответы в будущем. ”

Свежие комментарии